Overview

MLFlow propose une suite d'outils permettant de créer un workflow de Machine Learning. Nous nous intéressons au suivi, au registre de modèles et à l'évaluation. Nous l'utiliserons principalement pour comparer les exécutions d'entraînement avec différents jeux de données et paramètres, et pour stocker les modèles de Machine Learning résultants dans un registre.

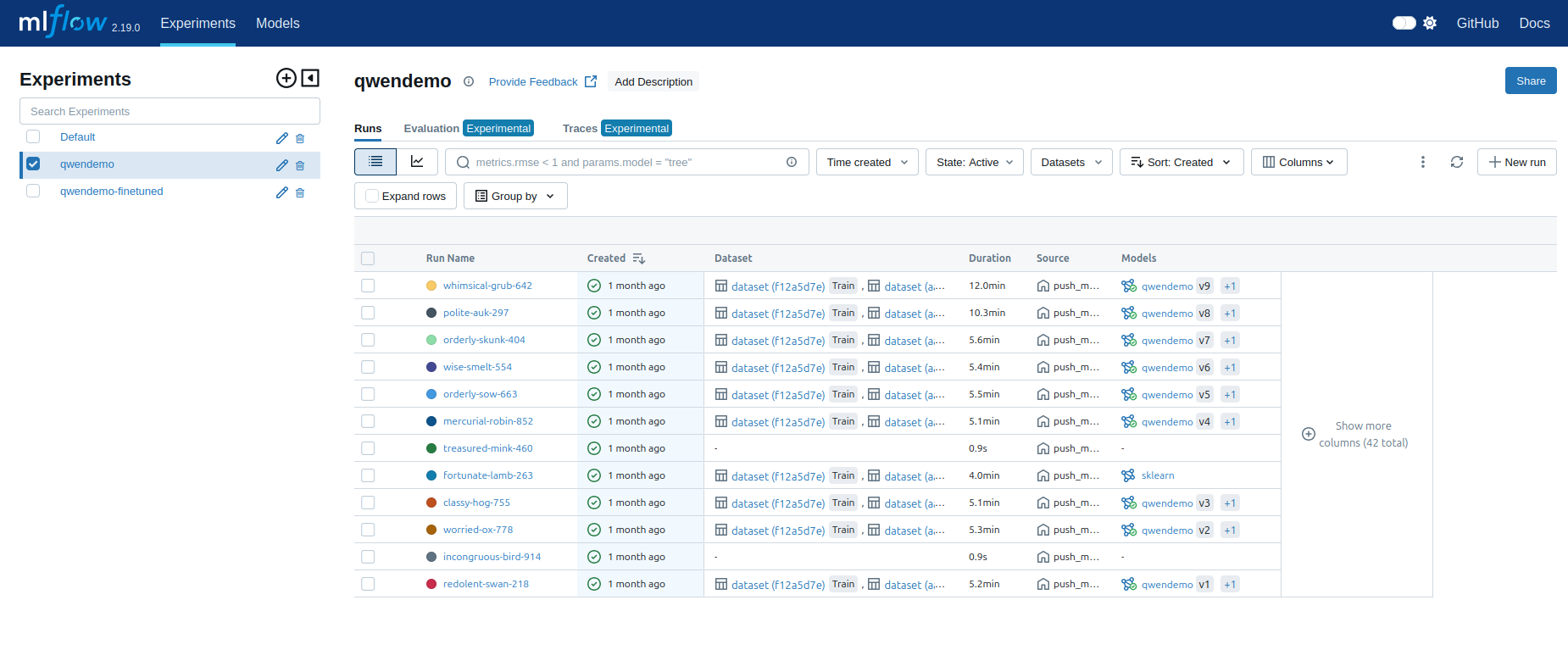

- Tracking: MLFlow fournit une API et une interface utilisateur dédiées à la journalisation des paramètres, des versions de code, des métriques et des artefacts pendant le processus de Machine Learning. Ce référentiel centralisé capture des informations telles que les paramètres, les métriques, les artefacts, les données et les configurations d'environnement, offrant ainsi aux équipes un aperçu de l'évolution de leurs modèles au fil du temps. Que ce soit dans des scripts autonomes, des notebooks ou d'autres environnements, le suivi facilite la journalisation des résultats dans des fichiers locaux ou sur un serveur, ce qui simplifie la comparaison de plusieurs exécutions entre différents utilisateurs.

- Model Registry: Approche systématique de la gestion des modèles, le registre de modèles facilite la gestion des différentes versions des modèles, l'identification de leur état actuel et la fluidité de leur mise en production. Il offre un magasin de modèles centralisé, des API et une interface utilisateur pour gérer de manière collaborative le cycle de vie complet d'un modèle MLFlow, y compris la lignée, la gestion des versions, l'aliasing, le balisage et les annotations.

- Evaluation: Conçu pour une analyse approfondie des modèles, cet ensemble d'outils facilite la comparaison objective des modèles, qu'il s'agisse d'algorithmes ML traditionnels ou de LLM de pointe.